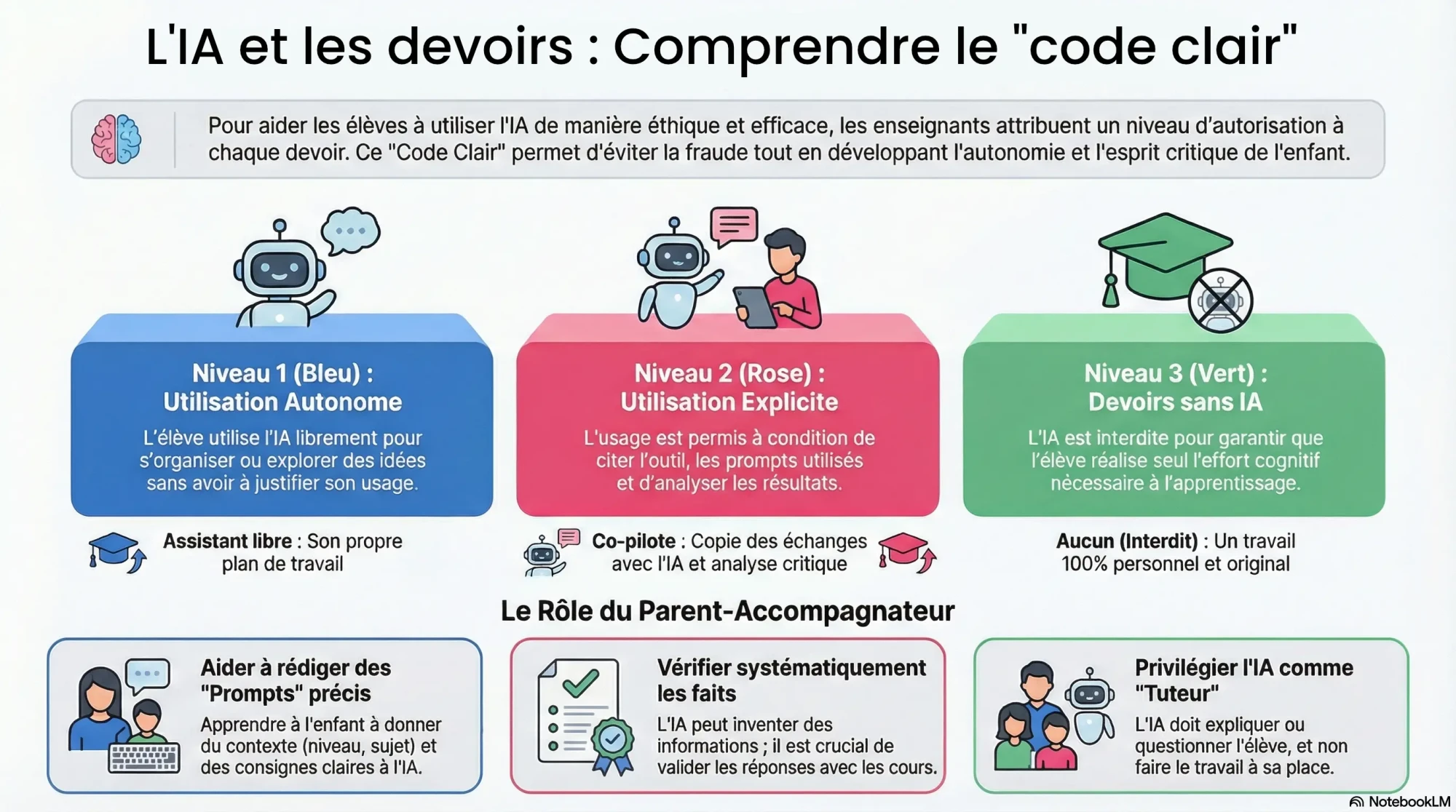

Depuis 2025, l’usage de ChatGPT pour faire ses devoirs est officiellement encadré par un système de « code clair » à trois niveaux : bleu (autonome), rose (explicite) et vert (sans IA). Ce dispositif, formalisé par l’Académie de Paris et intégré au cadre national de juin 2025. Il clarifie les attentes pédagogiques et définit juridiquement la fraude scolaire non plus par l’outil, mais par l’absence de transparence et de travail personnel.

Pourquoi encadrer l’usage de ChatGPT pour les devoirs ?

L’arrivée massive de l’intelligence artificielle dans les foyers a complètement chamboulé la réalité des devoirs maison. Entre 80 et 90 % des lycéens utilisent déjà des outils comme ChatGPT pour faire leurs devoirs, selon les données de l’Inspection Générale de l’Éducation de mai 2025. Face à cette adoption spontanée, les établissements se retrouvaient dans un flou total : fallait-il interdire ? Tolérer ? Sanctionner systématiquement ?

Père de trois adolescents de 12, 15 et 17 ans, j’ai découvert par hasard l’historique de conversation de mon fils aîné avec ChatGPT. Il venait de passer deux heures à débattre avec l’IA, de sa dissertation de philo. Pour être honnête, j’étais un peu dépité, assimilant ça à de la triche. Puis en lisant les échanges, je me suis rendu compte qu’il posait des questions plutôt intelligentes, il reformulait, il argumentait. Bref il travaillait. Différemment, mais vraiment.

Je pense que nous sommes des milliers de parents à avoir vécu quelque choses comme ça. Heureusement en juin 2025, le ministère de l’Éducation nationale a publié son « Cadre d’usage de l’IA en éducation ». Ce document pose un principe de base : l’outil n’est ni bon ni mauvais, c’est l’usage qui compte. Le « code clair » mis en place clarifie la situation en permettant de répondre à trois objectifs essentiels :

- Lever l’ambiguïté : chaque élève sait précisément ce qui est autorisé pour chaque travail.

- Responsabiliser : l’élève devient acteur de sa transparence plutôt que suspect par défaut.

- Former à l’esprit critique : apprendre à utiliser l’IA sans dépendance excessive ni plagiat involontaire.

L’enjeu dépasse la simple question technique. Il s’agit de préparer les jeunes à un monde où l’IA fera partie de la vie professionnelle, tout en préservant l’effort cognitif indispensable aux apprentissages fondamentaux.

Les trois niveaux du code clair décryptés

Le dispositif du « code clair » repose sur une logique pédagogique simple : adapter l’autorisation d’usage de l’IA selon l’objectif d’apprentissage visé. L’Académie de Paris, pionnière dans ce domaine, a formalisé trois niveaux identifiés par des couleurs.

Niveau 1 – Bleu : utilisation autonome

L’élève est libre d’utiliser ChatGPT pour faire ses devoirs comme il le souhaite, sans avoir à justifier ses interactions. Ce niveau vise les travaux d’exploration, de recherche documentaire ou d’organisation des idées. L’objectif pédagogique est de développer l’autonomie et la capacité à gérer un projet de bout en bout.

Niveau 2 – Rose/Magenta : utilisation explicite

L’usage de l’IA est autorisé mais doit être explicitement documenté. L’élève doit fournir en annexe la « cuisine de préparation » : quels prompts (instructions) ont été utilisés, comment les réponses ont été analysées, ce qui a été modifié ou rejeté. Ce niveau vise à développer la métacognition et l’esprit critique face aux productions artificielles.

Niveau 3 – Vert : devoirs sans IA

Aucun recours à l’intelligence artificielle n’est autorisé. Ce niveau concerne les exercices d’application directe, la mémorisation pure ou l’entraînement aux automatismes. L’objectif est de préserver l’effort cognitif personnel et de garantir l’acquisition solide des bases.

Depuis 2026, l’utilisation de ChatGPT pour faire ses devoirs sans respecter le niveau fixé par l’enseignant constitue officiellement une fraude académique, au même titre que la copie sur un camarade ou l’achat de devoirs en ligne.

« Le code clair transforme la relation de confiance : on passe du soupçon généralisé à une responsabilisation assumée. L’élève sait ce qu’on attend de lui. »

Groupe IA et Éducation, Académie de Paris, 2025.

Le niveau bleu en pratique. ChatGPT devient un assistant de recherche

Le niveau bleu correspond aux situations où l’enjeu n’est pas tant la production finale que le processus de réflexion et d’organisation. L’élève peut utiliser ChatGPT pour faire ses devoirs de manière totalement libre, sans contrainte de documentation.

Exemple concret : l’exposé sur le volcanisme (4ème)

La consigne de l’enseignant stipule : « Pour ton exposé sur le volcanisme, tu es libre d’utiliser l’IA comme tu le souhaites pour explorer le sujet, chercher des idées de plan ou organiser tes notes. Tu n’as pas besoin de justifier tes interactions avec l’outil. »

Dans ce cadre, l’élève peut :

- Demander à ChatGPT de lui suggérer un plan structuré

- Poser des questions pour comprendre la différence entre volcans effusifs et explosifs

- Obtenir des suggestions de sources fiables à consulter

- Reformuler des explications complexes dans un langage accessible

L’objectif pédagogique reste clair : l’élève doit s’approprier le contenu, le présenter devant la classe et répondre aux questions. L’IA n’est qu’un levier d’accès à l’information, comme pourrait l’être une encyclopédie ou un documentaire.

Les parents peuvent encourager cette utilisation en posant des questions de vérification : « Explique-moi avec tes propres mots ce que tu as compris sur les plaques tectoniques ». Cette démarche permet de s’assurer que ChatGPT n’a pas remplacé la réflexion, mais l’a nourrie.

Limites du niveau 1

Ce niveau ne convient pas aux travaux évalués sur la qualité rédactionnelle personnelle (dissertation, commentaire de texte) où l’expression individuelle est l’objectif central. Il concerne essentiellement les phases exploratoires ou organisationnelles d’un projet.

Le niveau rose en pratique : documenter pour encourager l’esprit critique

Le niveau rose représente une approche pédagogique innovante qui consiste à transformer l’IA en tuteur explicite, tout en développant une posture réflexive chez l’élève. L’usage de ChatGPT pour faire ses devoirs est autorisé, mais l’élève doit produire une trace de son processus intellectuel.

Exemple concret : la dissertation de philosophie (Terminale)

La consigne précise : « Utilise une IA pour t’aider à structurer le plan de ta dissertation sur « La liberté est-elle une illusion ? ». En annexe de ton travail, tu devras impérativement fournir ta méthodologie : quels outils et quels prompts as-tu utilisés ? Explique comment tu as analysé les réponses de l’IA et ce que tu as modifié pour aboutir à ton propre texte. »

Ce niveau oblige l’élève à :

- Formuler des questions précises : apprendre à « prompter » correctement développe la capacité à clarifier sa pensée

- Évaluer la pertinence des réponses : l’élève doit identifier les limites, les biais ou les hallucinations de ChatGPT

- Justifier ses choix : expliquer pourquoi telle réponse a été retenue et telle autre rejetée

- S’approprier le raisonnement : reformuler avec son propre vocabulaire et sa propre logique

Cette méthode développe ce que les chercheurs appellent la métacognition : la capacité à observer et comprendre son propre processus d’apprentissage.

À retenir : Le niveau 2 ne sanctionne pas l’usage de l’IA, mais l’absence de réflexion personnelle. Un élève qui copie-colle sans analyse sera en fraude, même s’il déclare avoir utilisé ChatGPT.

A titre d’exemple, ma fille de 15 ans a dû rendre un dossier sur le développement durable. Niveau rose. Elle a passé presque autant de temps à documenter ses échanges avec ChatGPT qu’à rédiger le dossier lui-même. Au début, si elle trouvait ça contraignant, elle m’a quand même dit avoir beaucoup appris sur la manière de vérifier une information. »

Bénéfices pour l’orientation future

Les compétences acquises au niveau 2 sont directement transférables dans l’enseignement supérieur et/ou le monde professionnel. Savoir collaborer avec une IA tout en gardant son jugement critique devient une compétence clé.

Le niveau vert en pratique : préserver l’effort cognitif pur

Le niveau vert correspond aux situations où l’usage de ChatGPT pour faire ses devoirs est strictement interdit. Cette interdiction ne relève pas d’une méfiance technologique, mais d’une nécessité pédagogique fondamentale : certains apprentissages exigent un effort cognitif direct que l’IA ne doit pas court-circuiter.

Exemple concret : exercices de mathématiques (3ème)

La consigne stipule : « Réalise cet exercice d’application directe du théorème de Pythagore sans aucun recours à l’IA. L’objectif est que tu maîtrises seul la procédure de calcul et que tu entraînes ta mémoire sans support technologique. »

Les situations relevant du niveau 3 incluent :

- Les automatismes : tables de multiplication, conjugaisons, formules de physique

- La mémorisation active : apprendre un poème, retenir des dates historiques

- Les exercices d’application directe : résoudre une équation, analyser une phrase grammaticalement

- Les évaluations diagnostiques : tester le niveau réel de l’élève sans assistance

L’enjeu est de garantir que l’élève dispose d’une base solide de connaissances internalisées, mobilisables sans dépendance à un outil externe. Cette base constitue le socle sur lequel pourront s’appuyer des raisonnements plus complexes assistés par l’IA.

Comment vérifier le respect du niveau 3 ?

Les enseignants privilégient les devoirs sur table, les interrogations orales ou les exercices réalisés en classe sous surveillance. Pour les travaux à la maison, la détection repose sur l’expertise humaine : un décalage flagrant entre le niveau habituel de l’élève et la qualité du rendu constitue un indice de non-respect du niveau vert.

Les détecteurs automatiques comme Turnitin ou GPTZero ne sont pas recommandés par le ministère en raison de leur manque de fiabilité : ils génèrent environ 50 % de fausses alertes, risquant de pénaliser injustement un élève honnête.

10 choses à retenir sur le code clair

Pour naviguer sereinement dans ce nouveau cadre, voici les points à mémoriser :

• Le code clair est obligatoire dès 2026 : intégré aux règlements intérieurs après délibération en Conseil d’administration, son non-respect constitue une fraude académique.

• Trois couleurs, trois niveaux : bleu (autonome), rose (explicite avec documentation), vert (interdit).

• L’enseignant fixe le niveau : chaque devoir doit préciser clairement le niveau d’autorisation pour éviter toute ambiguïté.

• La transparence protège l’élève : déclarer l’usage de ChatGPT au niveau 2 évite les accusations de triche et transforme l’outil en levier d’apprentissage.

• Les détecteurs automatiques ne sont pas fiables : le ministère déconseille leur usage en raison d’un taux d’erreur de 50 %.

• ChatGPT n’est pas un outil institutionnel : son usage relève du « régime du contrat privé », les établissements ne peuvent pas exiger la création de comptes personnels.

• Des alternatives souveraines existent : LUCIE, Mistral AI, MIA Seconde, P2IA (Lalilo, Adaptiv’math) respectent le RGPD et sont recommandées par l’Éducation nationale.

• Les sanctions sont graduées : refus du travail, note zéro, convocation des parents, jusqu’au conseil de discipline en cas de récidive ou fraude organisée.

• Les parents sont associés : les cafés IA et ateliers de sensibilisation permettent aux familles de comprendre les enjeux et d’accompagner leurs enfants.

• Le cadre légal est européen : le Règlement sur l’IA (RIA) entré en vigueur en août 2024 sera pleinement opérationnel en 2026 et classe les systèmes éducatifs comme « à haut risque ».

Fraude et responsabilité : ce que dit vraiment la loi

La question de la fraude avec ChatGPT pour faire ses devoirs est longtemps restée floue. Le cadre juridique de 2026 apporte des réponses précises, déplaçant le curseur de la détection technique vers l’exigence de transparence.

Les sanctions concrètes

Le non-respect du niveau fixé par l’enseignant peut entraîner :

- Refus du travail : l’élève doit refaire l’exercice dans le cadre autorisé

- Note zéro : si la fraude est avérée et documentée

- Convocation des parents : pour rappel du règlement intérieur

- Conseil de discipline : en cas de récidive ou de fraude organisée (revente de devoirs générés par IA)

À l’université, certains établissements comme Sciences Po Paris appliquent depuis 2023 une procédure d’exclusion pour usage non déclaré de l’IA dans les travaux évalués.

Le cadre légal en 2026

Trois textes structurent le dispositif :

- Le Règlement européen sur l’IA (RIA) : entré en vigueur le 1er août 2024, pleinement opérationnel en 2026, il classe les systèmes d’IA éducatifs comme « à haut risque »

- Le Cadre d’usage national : publié en juin 2025 par le ministère, il définit les règles de conduite pour le primaire et le secondaire

- Les règlements intérieurs : après délibération en Conseil d’administration, chaque établissement intègre une charte d’usage de l’IA précisant les sanctions

Statistiques sur la fraude

Les données de 2025 révèlent une réalité contrastée :

- 80 à 90 % des lycéens utilisent ChatGPT pour faire leurs devoirs

- 11 % des travaux contiennent au moins 20 % de contenu généré par IA

- 3 % des travaux sont rédigés à plus de 80 % par une IA

- 50 % de précision : c’est le taux réel de détection des enseignants, alors que 80 % pensent pouvoir identifier un texte artificiel

Une étude de Stanford montre que malgré l’IA, le taux global de fraude scolaire reste stable entre 60 et 70 % : les élèves qui trichent changent simplement d’outil.

L’humain reste l’arbitre final

La législation européenne interdit qu’une sanction soit prise de manière purement automatisée. L’enseignant doit acquérir la conviction de la fraude, souvent par un entretien oral de vérification où l’élève doit démontrer sa maîtrise du sujet.

« La preuve de fraude repose sur un décalage flagrant entre le niveau habituel de l’élève et la qualité du rendu, confirmé par un entretien où l’élève ne peut expliquer sa démarche. »

Cadre d’usage de l’IA en éducation, juin 2025.

Conseils pour les parents

Face à l’usage de ChatGPT pour faire ses devoirs, les parents oscillent souvent entre fascination et inquiétude. Voici des approches concrètes pour accompagner vos enfants selon leur âge et le contexte.

Pour les parents d’élèves du primaire

À ce niveau, les outils institutionnels comme Lalilo (français) ou Adaptiv’math (mathématiques) sont privilégiés dans le cadre du dispositif P2IA. ChatGPT reste dans la sphère privée.

- Action 1 : Demandez à l’enseignant quels outils sont utilisés en classe et comment les prolonger à la maison

- Action 2 : Si votre enfant utilise ChatGPT par curiosité, transformez cela en moment d’échange : « Qu’as-tu demandé ? Qu’as-tu appris ? »

- Action 3 : Initiez-le aux questions de vérification : « Comment sais-tu que cette réponse est vraie ? »

Pour les parents de collégiens

C’est l’âge des premières recherches autonomes et des premières tentations de délégation totale à l’IA.

- Action 1 : Consultez le règlement intérieur de l’établissement pour connaître la charte d’usage de l’IA

- Action 2 : Vérifiez systématiquement le niveau autorisé (bleu/rose/vert) avant chaque devoir

- Action 3 : Au niveau rose, demandez à voir le déroulement méthodologique : quels prompts ont été utilisés ? Qu’a-t-il modifié ?

- Action 4 : Posez des questions ouvertes pour vérifier la compréhension : « Explique-moi ce que tu as retenu sur la Révolution française »

Pour les parents de lycéens

L’enjeu est de préparer l’autonomie tout en évitant la dépendance excessive.

- Action 1 : Discutez ouvertement des risques de fraude et des sanctions en conseil de discipline

- Action 2 : Valorisez les usages intelligents : « ChatGPT t’a aidé à structurer ton plan ? Montre-moi comment tu as vérifié ses propositions »

- Action 3 : Participez aux cafés IA organisés par l’établissement pour comprendre les outils et les enjeux

- Action 4 : Encouragez l’usage des alternatives souveraines comme MIA Seconde ou LUCIE pour la remédiation

Dialogue à instaurer

Avant d’utiliser ChatGPT, encourager vos enfants à d’abord réfléchir seuls pendant 10 minutes. Si après ce délai ils sont vraiment bloqués, ils peuvent poser une question à l’IA, mais ils doivent pouvoir expliquer la réponse obtenue. Cette méthode transforme l’IA en assistant plutôt qu’en substitut à la réflexion.

Les cafés IA : un espace d’échange précieux

Environ 70 % des parents souhaitent être conseillés par l’école sur la sécurité en ligne et l’usage des outils numériques. Les cafés IA, organisés dans les établissements ou les maisons de quartier, abordent des sujets très concrets comme :

- Comprendre le fonctionnement technique des IA génératives

- Identifier les biais algorithmiques et les hallucinations

- Encadrer l’usage à la maison selon le niveau scolaire

- Protéger les données personnelles (RGPD)

Ces ateliers permettent aux parents de passer d’une posture de méfiance à une agentivité partagée.

Ce que signifie concrètement ‘agentivité partagée’

Passer de :

- Consommation passive : « Mon enfant utilise ChatGPT, je ne sais pas comment ça marche »

- Délégation totale : « C’est l’école qui doit gérer ça »

- Interdiction aveugle : « J’interdis ChatGPT sans comprendre »

À :

- Co-construction : Parents + enseignants + élèves définissent ensemble les règles d’usage

- Maîtrise technique partagée : Tous comprennent comment fonctionne l’outil

- Responsabilité distribuée : Chacun devient acteur de l’éducation numérique

Les 3 piliers de l’agentivité partagée

- Compréhension commune : Parents et enseignants parlent le même langage technique (prompts, hallucinations, biais)

- Décision collective : Les règles du code clair sont co-élaborées lors des cafés IA, pas imposées unilatéralement

- Action coordonnée : À la maison comme en classe, les adultes utilisent les mêmes grilles de questionnement critique

Exemple pratique

Sans agentivité partagée :

- Parent : « Pourquoi tu utilises ChatGPT ? »

- Enfant : « Le prof a rien dit… »

- Résultat : flou, tension, utilisation non déclarée

Avec agentivité partagée :

- Parent (formé au café IA) : « Tu es en niveau rose, montre-moi tes prompts et explique moi ce que tu as modifié »

- Enfant : « Voilà mon annexe, j’ai vérifié les 3 sources »

- Résultat : dialogue constructif, apprentissage explicite

Origine du concept

Le terme vient des sciences cognitives et de la philosophie de l’action (Margaret Gilbert, Michael Bratman). Il a été adapté à l’éducation numérique par les chercheurs en littératie numérique pour désigner cette responsabilité horizontale où chacun devient « pilote » de la technologie.

❓ 5 Questions fréquentes : ChatGPT pour faire ses devoirs